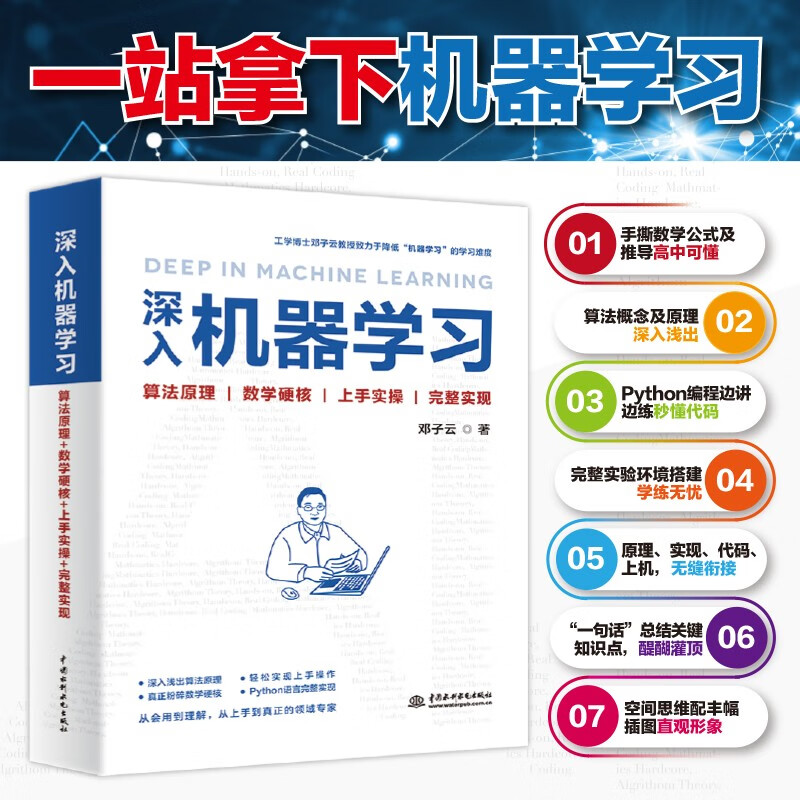

包邮深入机器学习:算法原理 数学硬核 上手实操 完整实现

- ISBN:9787522610801

- 装帧:一般胶版纸

- 册数:暂无

- 重量:暂无

- 开本:16开

- 页数:520

- 出版时间:2023-01-01

- 条形码:9787522610801 ; 978-7-5226-1080-1

本书特色

适读人群 :计算机、人工智能、大数据等专业的大学生、研究生、需要用到机器学习技术的广大工程技术人员、研究人员机器学习对于众多软件从业人员的诱惑是无需多言的。然而樱桃好吃树难栽,大多数初学者*终未能到达成功的彼岸,不少甚至连“中途”未到就放弃了。 工作关系,我也曾经多次试图走进机器学习的殿堂。每次所下的决心虽然不小但却无功而返。放弃的原因并不复杂,经常都是由于对一个概念、一个原理、一个公式实在无法理解所导致的。比如,我看过的书中,关于线性回归都是引用现成的算法函数,没有看到过这个函数在数学上倒底是怎么实现的,因此对于给定的几个散点,如果不借助现成的算法函数,我确实没搞明白怎么才能拟合出相应的回归方程。线性回归是机器学习算法中*基本、*简单的算法,但我怎么敢说自己真正理解了线性回归呢? 相关的图书买了不少看了不少,浪费些脑细胞不算事儿,心里不好迈过的那道坎是买书浪费了很多钱。作为一名老图书编辑,牢骚之后往往会对所看的这些书做一些思考或幻想,比如:你不讲一下机器学习实验环境配置读者怎么边学边做?这个算法原理感觉这么晦涩到底是因为作者水平太高还是因为我水平太低?这个数学公式如果给出推导过程我是不是就不用东查西查了?公式中的这些符号为什么不能解释一下?这个地方如果能举个例子该有多好?这个地方配个图多直观?…… 我向大家推荐邓子云老师这本机器学习的书,仅仅是因为我在编辑此书的过程中感觉到,他精确地假设了我的水平,他精确地知道每一个知识点怎么讲、讲到什么程度我才能懂,他精确地知道我在每一个地方会产生什么样的疑惑。后来有一次与邓老师吃饭时我说:“邓老师,你就像我肚子里的蛔虫”,邓老师说:“你学习过程中遇到的坑我基本都遇到过,我只是尽力把坑填平”。 简单的一句话,背后凝聚的是邓子云老师多年关于机器学习的教学、知识、实践、经验、思考及责任。这本七十余万字的长篇巨著,蕴含了数百张精心设计的实战插图,数十个的公式详细推导过程及讲解,字里行间的点点珠玑,深入浅出的醍醐灌顶…… 尽管感觉本书还有不少可优化之处,但它确实使我在机器学习的征途中走出了*远的距离。 周春元

内容简介

本书将带领读者一起主动拥抱机器学习,快乐翻越高等数学、算法分析、工程实践这“三座大山”。面对三类读者(会用即可、想深入学习、想成为专家)的学习动机和阅读需求,全书一共用19章来讲解机器学习的各种模型,包括机器学习中基础和关键的线性回归、逻辑回归、决策树、贝叶斯、支持向量机、KNN等。全书具有语言表达轻快、模型讲解细致、图表配备众多的特色。 本书可供计算机、人工智能、大数据等专业的大学生、研究生阅读,也可供需要用到机器学习技术的广大工程技术人员、研究人员作为参考。

目录

作者简介

邓子云:工学博士,教授,擅长将复杂的问题简单化,酷爱机器学习与数学,希望通过本书,把个人在机器学习方面的心得、经验、系统性知识,分享给那些正在经受机器学习中的复杂概念、原理、数学推导等问题困扰的同学或同仁。已出版著作20余本,发表论文110余篇。主持过国家级、省部级科研课题40余项。

-

造神:人工智能神话的起源和破除 (精装)

¥32.7¥88.0 -

大数据技术导论(第2版)

¥28.9¥41.0 -

人人都能学AI

¥40.4¥68.0 -

人工智能

¥20.3¥55.0 -

系统架构设计师教程(第2版)(全国计算机技术与软件专业技术资格(水平)考试指定用

¥102.7¥158.0 -

过程控制技术(第2版高职高专规划教材)

¥27.6¥38.0 -

数据结构基础(C语言版)(第2版)

¥41.7¥49.0 -

WPS OFFICE完全自学教程(第2版)

¥97.3¥139.0 -

智能视频目标检测与识别技术

¥43.5¥59.0 -

人工智能基础及应用

¥36.0¥48.0 -

深入浅出软件架构

¥117.2¥186.0 -

计算机网络基础(微课版)

¥39.0¥55.0 -

剪映:即梦AI绘画与视频制作从新手到高手

¥66.0¥89.0 -

红蓝攻防 技术与策略(原书第3版)

¥95.9¥139.0 -

Web前端开发基础

¥37.5¥57.0 -

软件设计的哲学(第2版)

¥52.0¥69.8 -

人工智能的底层逻辑

¥58.7¥79.0 -

软件工程理论与案例

¥63.4¥99.0 -

剪映+PREMIERE+AIGC 短视频制作速成

¥73.5¥98.0 -

剪映AI

¥52.0¥88.0