- ISBN:9787522612669

- 装帧:平装-胶订

- 册数:暂无

- 重量:暂无

- 开本:16开

- 页数:384

- 出版时间:2022-12-01

- 条形码:9787522612669 ; 978-7-5226-1266-9

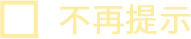

本书特色

本书适用于对Java基础知识有一定的掌握,渴望深入学习Java并发进阶知识的开发者;也适用于渴求成功进入大型互联网公司的开发者;还适用于对Java并发以及并发组件设计模式感兴趣的开发者。

内容简介

本书系统化地分析和介绍了Java并发领域,全书共12章,可分为四个部分。**部分为并发概述(第1章),这部分介绍并发的发展历史,激发读者对并发学习的热情。第二部分为Java基础原理(第2~3章),这部分介绍了并发模型的基础理论知识。第三部分为并发工具(第4~7章),这部分不仅从源码实现的原理上分析j.u.c包中提供的Java并发工具,还对组件的设计方式进行了探索。第四部分为Java实践(第8~12章),这部分深入浅出地分析了开源常见的并发框架,学习这部分知识可进一步提升并发编程的效率。本书适用于对Java基础有一定的掌握,渴望深入学习Java并发进阶知识的开发者;也适用于渴求成功进入大型互联网公司的开发者;还适用于对Java并发以及并发组件设计模式感兴趣的开发者。

目录

作者简介

曹亮,长期就职于国内一线互联网企业,担任资深Java开发以及Java技术专家,对资金清结算领域以及系统稳定性建设有一定的掌握,擅长软件开发知识结构的总结沉淀,在论坛上博客有超百万阅读量。郑程,拥有10年互联网IT从业经历,其中深耕金融科技领域6年以上,熟悉互联网金融和资金清结算架构体系。目前是某一线互联网公司资产经营团队的技术负责人,负责核心业务架构和团队管理。对于互联网高并发编程和领域驱动设计有深入的理解,曾一手打造了支持高并发处理能力的金融平台。

-

全图解零基础word excel ppt 应用教程

¥15.6¥48.0 -

有限与无限的游戏:一个哲学家眼中的竞技世界

¥37.4¥68.0 -

硅谷之火-人与计算机的未来

¥12.7¥39.8 -

机器学习

¥59.4¥108.0 -

情感计算

¥66.8¥89.0 -

LINUX企业运维实战(REDIS+ZABBIX+NGINX+PROMETHEUS+GRAFANA+LNMP)

¥48.3¥69.0 -

AI虚拟数字人:商业模式+形象创建+视频直播+案例应用

¥62.9¥89.8 -

LINUX实战——从入门到精通

¥48.3¥69.0 -

UNIX环境高级编程(第3版)

¥164.9¥229.0 -

剪映AI

¥52.8¥88.0 -

数据驱动的工业人工智能:建模方法与应用

¥68.3¥99.0 -

深度学习高手笔记 卷2:经典应用

¥90.9¥129.8 -

纹样之美:中国传统经典纹样速查手册

¥76.3¥109.0 -

UG NX 12.0数控编程

¥24.8¥45.0 -

MATLAB计算机视觉与深度学习实战(第2版)

¥90.9¥128.0 -

UN NX 12.0多轴数控编程案例教程

¥24.3¥38.0 -

微机组装与系统维护技术教程(第二版)

¥37.8¥43.0 -

Go 语言运维开发 : Kubernetes 项目实战

¥38.7¥79.0 -

明解C语言:实践篇

¥62.9¥89.8 -

Linux服务器架设实战(Linux典藏大系)

¥84.5¥119.0