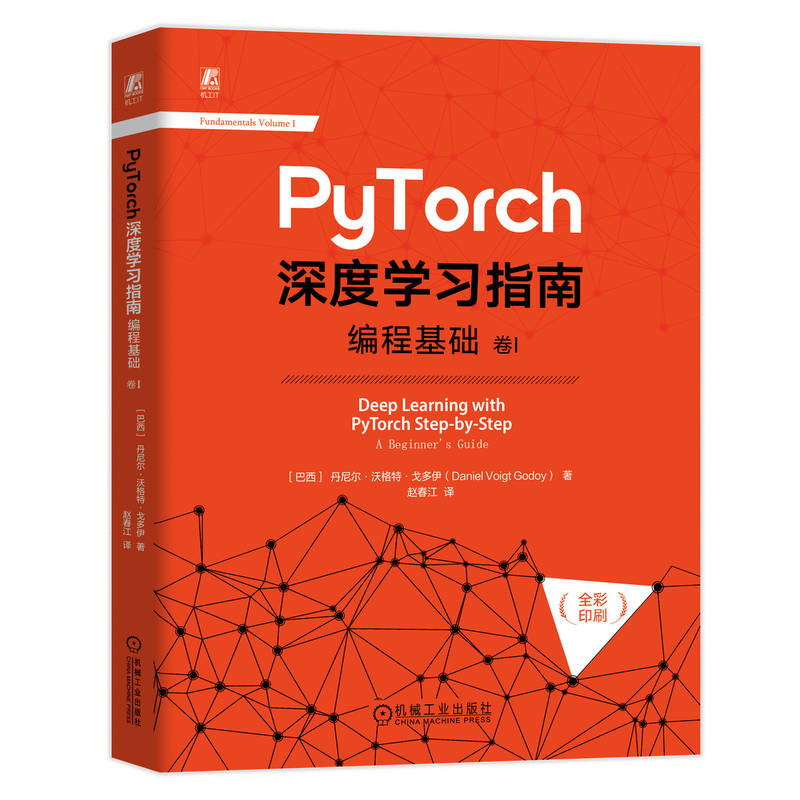

- ISBN:9787111749783

- 装帧:简裝本

- 册数:暂无

- 重量:暂无

- 开本:16开

- 页数:182

- 出版时间:2024-03-01

- 条形码:9787111749783 ; 978-7-111-74978-3

本书特色

国外Pytorch深度学习畅销书 全彩印刷

作者拥有20余年从业经验

“PyTorch深度学习指南”丛书循序渐进地详细讲解了与深度学习相关的重要概念、算法和模型,并着重展示了PyTorch是如何实现这些算法和模型的。其共分三卷:编程基础、计算机视觉、序列与自然语言处理。

本书适用于对深度学习感兴趣,并希望使用PyTorch实现深度学习的Python程序员阅读。

以下是部分国外读者书评:

Mike:语言通俗易懂,易于吸收和理解,没有长篇大论,也没有太多的数学符号,只在极少数情况下才在文中使用,确实很有帮助。作者带你了解如何在没有Torch的情况下首先构建和训练神经网络,以及梯度下降之类的事情是如何运作的。

Mark:这本书很棒!我能够在几天内读完它,它非常容易理解。我很熟悉scikit-learn,已经用了几年了,所以这本书是一种快速适应PyTorch的方法。对ML概念的回顾足够深入,所以我理解了代码。我现在开始读第二卷!

TS.:这本书不只是把代码推到你面前,它解释了事物在引擎盖下是如何工作的。我非常喜欢这种风格,所以我把这本书及其第二卷作为我的ECE655高级GPU编程和深度学习课程的教材。

Jesse:我喜欢这位作家的风格。他从深度学习背后的基本概念开始,带领你从自己硬编码梯度下降到使用PyTorch高效实现,逐步提高抽象和复杂性。*后,你将能够在PyTorch中编写一个干净紧凑的模型,并且了解每个子组件在后台做什么。

内容简介

“PyTorch深度学习指南”丛书循序渐进地详细讲解了与深度学习相关的重要概念、算法和模型,并着重展示了PyTorch是如何实现这些算法和模型的。其共分三卷:编程基础、计算机视觉、序列与自然语言处理。

本书为该套丛书的**卷:编程基础。本书主要介绍了梯度下降和PyTorch的Autograd;训练循环、数据加载器、小批量和优化器;二元分类器、交叉熵损失和不平衡数据集;决策边界、评估指标和数据可分离性等内容。

本书适用于对深度学习感兴趣,并希望使用PyTorch实现深度学习的Python程序员阅读学习。

目录

致 谢

关于作者

译者序

常见问题

为什么选择PyTorch?

为什么选择这套书?

谁应该读这套书?

我需要知道什么?

如何阅读这套书?

下一步是什么?

设置指南

官方资料库

环境

谷歌Colab

Binder

本地安装

继续

第0章 可视化梯度下降

剧透

Jupyter Notebook

导入

可视化梯度下降

模型

数据生成

合成数据生成

训练-验证-测试拆分

第0步——随机初始化

第1步——计算模型的预测

第2步——计算损失

损失面

横截面

第3步——计算梯度

可视化梯度

反向传播

第4步——更新参数

学习率

第5步——循环往复

梯度下降的路径

回顾

第1章 一个简单的回归问题

剧透

Jupyter Notebook

导入

一个简单的回归问题

数据生成

合成数据生成

梯度下降

第0步——随机初始化

第1步——计算模型的预测

第2步——计算损失

第3步——计算梯度

第4步——更新参数

第5步——循环往复

Numpy中的线性回归

PyTorch

张量

加载数据、设备和CUDA

创建参数

Autograd

backward

grad

zero_

更新参数

no_grad

动态计算图

优化器

step/zero_grad

损失

模型

参数

state_dict

设备

前向传递

训练

嵌套模型

序列(Sequential)模型

层

归纳总结

数据准备

模型配置

模型训练

回顾

第2章 重新思考训练循环

剧透

Jupyter Notebook

导入

重新思考训练循环

训练步骤

Dataset

TensorDataset

DataLoader

小批量内循环

随机拆分

评估

绘制损失

TensorBoard

在Notebook中运行

单独运行(本地安装)

单独运行(Binder)

SummaryWriter

add_graph

add_scalars

保存和加载模型

模型状态

保存

恢复训练

部署/做出预测

设置模型的模式

归纳总结

回顾

第2.1章 追求优雅

剧透

Jupyter Notebook

导入

追求优雅

类

构造方法

训练方法

保存和加载方法

可视化方法

完整代码

典型的管道

模型训练

做出预测

检查点

恢复训练

归纳总结

回顾

第3章 一个简单的分类问题

剧透

Jupyter Notebook

导入

一个简单的分类问题

数据生成

数据准备

模型

logit

概率

比值比(Odds Ratio)

对数比值比

从logit到概率

Sigmoid

逻辑斯蒂回归

损失

BCELoss

BCEWithLogitsLoss

不平衡数据集

模型配置

模型训练

决策边界

分类阈值

混淆矩阵

指标

权衡和曲线

归纳总结

回顾

作者简介

丹尼尔?沃格特?戈多伊是一名数据科学家、开发人员、作家和教师。自2016年以来,他一直在柏林历史*悠久的训练营Data Science Retreat讲授机器学习和分布式计算技术,帮助数百名学生推进职业发展。

丹尼尔还是两个Python软件包——HandySpark和DeepReplay的主要贡献者。

他拥有在多个行业20多年的工作经验,这些行业包括银行、政府、金融科技、零售和移动出行等。

-

大模型应用开发极简入门 基于GPT-4和ChatGPT

¥41.9¥59.8 -

这就是ChatGPT

¥41.9¥59.8 -

电脑组装、选购、操作、维护、维修从入门到精通

¥32.2¥48.0 -

数据结构教程(第6版·微课视频·题库版)

¥46.5¥65.0 -

计算机组成原理实验指导与习题解析

¥34.8¥52.0 -

微信小程序开发教程

¥31.4¥49.0 -

机器学习

¥47.4¥108.0 -

C程序设计(第五版)

¥18.6¥49.0 -

深度学习导论

¥24.5¥49.0 -

有限与无限的游戏:一个哲学家眼中的竞技世界

¥36.4¥68.0 -

RFID与智能卡技术实验指导书

¥28.4¥36.0 -

UNITY游戏开发经典实例

¥73.0¥128.0 -

软件开发技术基础 第4版

¥65.7¥79.9 -

软件测试

¥50.0¥68.0 -

AIGC文图学 人类3.0时代的生产力

¥36.0¥48.0 -

AFter Effects 影视后期特效实战教程

¥45.0¥69.8 -

生物特征识别算法研究

¥20.1¥39.0 -

大模型应用开发动手做AIAGENT

¥62.9¥89.8 -

游戏造物主;游戏与制作人的幕后故事

¥63.6¥108.0 -

python语言程序设计(第2版)(含视频教学)

¥50.6¥69.9