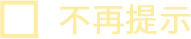

PyTorch深度学习指南:序列与自然语言处理 卷III

- ISBN:9787111744597

- 装帧:平装-胶订

- 册数:暂无

- 重量:暂无

- 开本:16开

- 页数:310

- 出版时间:2024-03-01

- 条形码:9787111744597 ; 978-7-111-74459-7

本书特色

国外Pytorch深度学习畅销书 全彩印刷

作者拥有20余年从业经验

“PyTorch深度学习指南”丛书循序渐进地详细讲解了与深度学习相关的重要概念、算法和模型,并着重展示了PyTorch是如何实现这些算法和模型的。其共分三卷:编程基础、计算机视觉、序列与自然语言处理。

本书适用于对深度学习感兴趣,并希望使用PyTorch实现深度学习的Python程序员阅读。

以下是部分国外读者书评

Michael:理解GPT的敲门砖!

我对这本书感到惊讶,以我生疏的数学技能,居然可以从头到尾毫无问题地阅读。这三本系列丛书是我能完全理解的**套深度学习书。作者基本上使用*小数据样本的逐步代码来完成任何机制/数学。

真是我相见恨晚的一套丛书。

Sebastian:这本书写得非常好。对非常高级的概念进行了清晰、全面、易懂的解读。提供的实现细节帮助您快速轻松地进入深度学习领域。

内容简介

本书涵盖了从梯度下降的基础知识一直到使用HuggingFace库微调大型自然语言处理模型(BERT和GPT-2)。它分为四个部分——**部分:基础知识(梯度下降,在PyTorch中训练线性和逻辑回归);第二部分:计算机视觉(更深层次的模型和激活函数、卷积、迁移学习、初始化方案);第三部分:序列(RNN、GRU、LSTM、序列到序列模型、注意力、自注意力、转换器);第四部分:自然语言处理(词元化、嵌入、上下文词嵌入、ELMo、BERT、GPT-2)。 该书以三卷的形式呈现给大家,**部分为**卷,第二部分为第二卷,第三部分和第四部分为第三卷。 在第三卷中,您将了解与序列相关的所有内容:循环神经网络及其变体、序列到序列模型、注意力、自注意力和转换器。本卷还包括有关自然语言处理的速成教程,从单词词元化的基础知识一直到使用HuggingFace库微调大型模型(BERT和GPT-2)。本卷比其他两卷要求更高,如果您已经对深度学习模型有扎实的理解,您会更喜欢它。这其中包括: ?循环神经网络(RNN、GRU和LSTM)和一维卷积。 ?序列到序列模型、注意力、掩码和位置编码。 ?转换器、层归一化和视觉转换器(ViT)。 ?BERT、GPT-2、词嵌入和HuggingFace库。

目录

致 谢

关于作者

译者序

常见问题

为什么选择PyTorch?

为什么选择这套书?

谁应该读这套书?

我需要知道什么?

如何阅读这套书?

下一步是什么?

设置指南

官方资料库

环境

谷歌Colab

Binder

本地安装

继续

第8章 序列

剧透

Jupyter Notebook

导入

序列

数据生成

循环神经网络(RNN)

RNN单元

RNN层

形状

堆叠RNN

双向RNN

正方形模型

可视化模型

我们能做得更好吗?

门控循环单元(GRU)

GRU单元

GRU层

正方形模型Ⅱ——速成

模型配置和训练

可视化模型

我们能做得更好吗?

长短期记忆(LSTM)

LSTM单元

LSTM层

正方形模型Ⅲ——巫师

模型配置和训练

可视化隐藏状态

可变长度序列

填充

打包

解包(至填充)

打包(从填充)

可变长度数据集

数据准备

正方形模型Ⅳ——打包

模型配置和训练

一维卷积

形状

多特征或通道

膨胀

数据准备

模型配置和训练

可视化模型

归纳总结

固定长度数据集

可变长度数据集

选择一个合适的模型

模型配置和训练

回顾

第9章(上):序列到序列

剧透

Jupyter Notebook

导入

序列到序列

数据生成

编码器-解码器架构

编码器

解码器

编码器 解码器

数据准备

模型配置和训练

可视化预测

我们能做得更好吗?

注意力

“值”

“键”和“查询”

计算上下文向量

评分方法

注意力分数

缩放点积

注意力机制

源掩码

解码器

编码器 解码器 注意力机制

模型配置和训练

可视化预测

可视化注意力

多头注意力

第9章(下):序列到序列

剧透

自注意力

编码器

交叉注意力

解码器

编码器 解码器 自注意力机制

模型配置和训练

可视化预测

不再有序

位置编码(PE)

编码器 解码器 位置编码

模型配置和训练

可视化预测

可视化注意力

归纳总结

数据准备

模型组装

编码器 解码器 位置编码

自注意力的“层”

注意力头

模型配置和训练

回顾

第10章 转换和转出

剧透

Jupyter Notebook

导入

转换和转出

狭义注意力

分块

多头注意力

堆叠编码器和解码器

包裹“子层”

Transformer编码器

Transformer解码器

层归一化

批量与层

我们的Seq2Seq问题

投影或嵌入

Transformer

数据准备

模型配置和训练

可视化预测

PyTorch的Transformer

模型配置和训练

可视化预测

视觉Transformer

数据生成和准备

补丁

特殊分类器词元

模型

模型配置和训练

归纳总结

数据准备

模型组装

模型配置和训练

回顾

第11章 Down the Yellow Brick Rabbit Hole

剧透

Jupyter Notebook

附加设置

导入

“掉进黄砖兔子洞(Down the Yellow Brick Rabbit Hole)”

构建数据集

句子词元化

HuggingFace的数据集

加载数据集

单词词元化

词汇表

HuggingFace的词元化器

单词嵌入之前

独热(One-Hot)编码(OHE)

词袋(BoW)

语言模型

N元(N-gram)

连续词袋(CBoW)

单词嵌入

Word2Vec

什么是嵌入?

预训练的Word2Vec

全局向量(GloVe)

使用单词嵌入

模型Ⅰ——GloVE 分类器

模型Ⅱ——GloVe Transformer

上下文单词嵌入

ELMo

BERT

文档嵌入

模型Ⅲ——预处理嵌入

BERT

词元化

输入嵌入

预训练任务

输出

模型Ⅳ——使用BERT进行分类

使用HuggingFace进行微调

序列分类(或回归)

词元化数据集

训练器

预测

管道

更多管道

GPT-2

归纳总结

数据准备

模型配置和训练

生成文本

回顾

谢谢您!

作者简介

丹尼尔•沃格特•戈多伊是一名数据科学家、开发人员、作家和教师。自2016年以来,他一直在柏林历史*悠久的训练营Data Science Retreat讲授机器学习和分布式计算技术,帮助数百名学生推进职业发展。

丹尼尔还是两个Python软件包——HandySpark和DeepReplay的主要贡献者。

他拥有在多个行业20多年的工作经验,这些行业包括银行、政府、金融科技、零售和移动出行等。

赵春江,博士,毕业于上海交通大学。现任职于合肥学院,副教授,在信息处理领域有着十余年丰富的教学和科研经验。共主持过3项省级教科研项目,在国内外期刊和会议中共发表20多篇学术论文,其中被SCI或EI检索共计12篇,曾出版过四本关于数字信号处理、图像处理、以及机器学习方面的书籍。

-

有限与无限的游戏:一个哲学家眼中的竞技世界

¥37.4¥68.0 -

硅谷之火-人与计算机的未来

¥14.3¥39.8 -

全图解零基础word excel ppt 应用教程

¥12.0¥48.0 -

机器学习

¥59.4¥108.0 -

深度学习的数学

¥43.5¥69.0 -

智能硬件项目教程:基于ARDUINO(第2版)

¥37.7¥65.0 -

元启发式算法与背包问题研究

¥38.2¥49.0 -

AI虚拟数字人:商业模式+形象创建+视频直播+案例应用

¥62.9¥89.8 -

UNIX环境高级编程(第3版)

¥164.9¥229.0 -

剪映AI

¥52.8¥88.0 -

深度学习高手笔记 卷2:经典应用

¥90.9¥129.8 -

纹样之美:中国传统经典纹样速查手册

¥77.4¥109.0 -

UG NX 12.0数控编程

¥24.8¥45.0 -

MATLAB计算机视觉与深度学习实战(第2版)

¥90.9¥128.0 -

界面交互设计理论研究

¥30.8¥56.0 -

UN NX 12.0多轴数控编程案例教程

¥25.8¥38.0 -

微机组装与系统维护技术教程(第二版)

¥37.8¥43.0 -

Go 语言运维开发 : Kubernetes 项目实战

¥48.2¥79.0 -

明解C语言:实践篇

¥62.9¥89.8 -

Linux服务器架设实战(Linux典藏大系)

¥84.5¥119.0